如何优化代码架构_如何优化代码架构

*** 次数:1999998 已用完,请联系开发者***

字节跳动豆包大模型团队开源MoE架构优化技术,训练成本节省40%IT之家 3 月 10 日消息,字节跳动豆包大模型团队官宣开源一项针对 MoE(混合专家模型)架构的关键优化技术,可将大模型训练效率提升 1.7 倍,成... 目前,COMET 核心代码已开源,并计划兼容 Triton 等编译生态。论文链接:https://arxiv.org/pdf/2502.19811开源地址:https://github.com/bytedance...

现实or虚幻?年轻人面对这一困惑,到底该咋选?他觉得代码背后肯定还有更深层次的逻辑和优化空间。于是,他一头扎进技术的海洋,研究各种算法和架构。别的同事下班就躺平打游戏,他却在不断学习和实践。经过长时间的努力,他开发出了一套高效的代码优化方案,大大提高了公司项目的运行效率。这波操作直接封神,他也因此得到了...

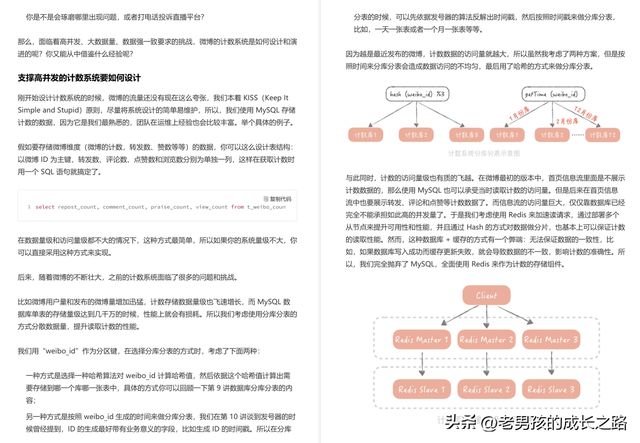

从0到1构建企业级低代码平台:后端技术选型剖析本文将深入拆解从零开始构建企业级低代码平台的全过程中,后端技术选型所涉及的核心维度,包括主流技术栈的深度对比与抉择、支撑高并发高可用的架构蓝图设计、以及数据库选型与优化的关键策略,旨在为低代码平台产品经理和架构师提供一份详实、落地的后端建设指南。一、 后...

ˋ^ˊ

富士康母公司注册AI推理大模型商标申请注册“FoxBrain”商标,国际分类为科学仪器,当前商标状态为注册申请中。据媒体报道,FoxBrain是鸿海集团(富士康)旗下鸿海研究院自主研发的首款繁体中文AI推理大模型。该模型于今年3月正式发布,基于Meta Llama 3.1架构开发优化,专注于数学推演、逻辑分析与代码生成领域。

ˇ▽ˇ 富士康母公司申请注册AI推理大模型商标注册“FoxBrain”商标,国际分类为科学仪器,当前商标状态为等待实质审查。据媒体报道,FoxBrain是鸿海集团(富士康)旗下鸿海研究院自主研发的首款繁体中文AI推理大模型。该模型于今年3月正式发布,基于Meta Llama 3.1架构开发优化,专注于数学推演、逻辑分析与代码生成领域。

鸿海精密工业股份有限公司申请注册AI推理大模型商标注册“FoxBrain”商标,国际分类为科学仪器,当前商标状态为等待实质审查。据媒体报道,FoxBrain是鸿海集团(富士康)旗下鸿海研究院自主研发的首款繁体中文AI推理大模型。该模型于今年3月正式发布,基于MetaLlama3.1架构开发优化,专注于数学推演、逻辑分析与代码生成领域。

ˋ△ˊ

∪△∪ DeepSeek-V3升级:评测达75.9%正确率,代码生成提速40%人工智能领域迎来重大突破,DeepSeek于2025年3月24日发布DeepSeek-V3模型。该模型在MMLU-pro测试中达到75.9%的正确率,在代码生成、长文本处理等多个领域展现出卓越性能。技术创新引领突破DeepSeek-V3通过MoE架构的深度优化,实现了代码生成响应延迟降低40%。模型...

ˇωˇ

山外山重构组织架构,力促经营管理升级山外山(股票代码:688410)近日发布官方公告,宣布其董事会于2024年9月9日通过了关于公司组织架构调整与优化的决议。此次调整旨在进一步强化和优化公司治理结构,以更高效地支撑公司的日常运营与长期发展策略。公告明确说明,此次调整主要聚焦于内部管理机构的重组与升级,预计...

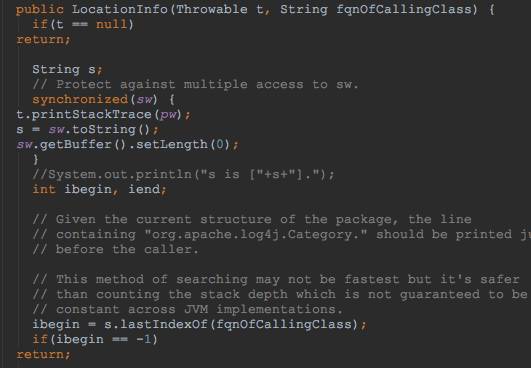

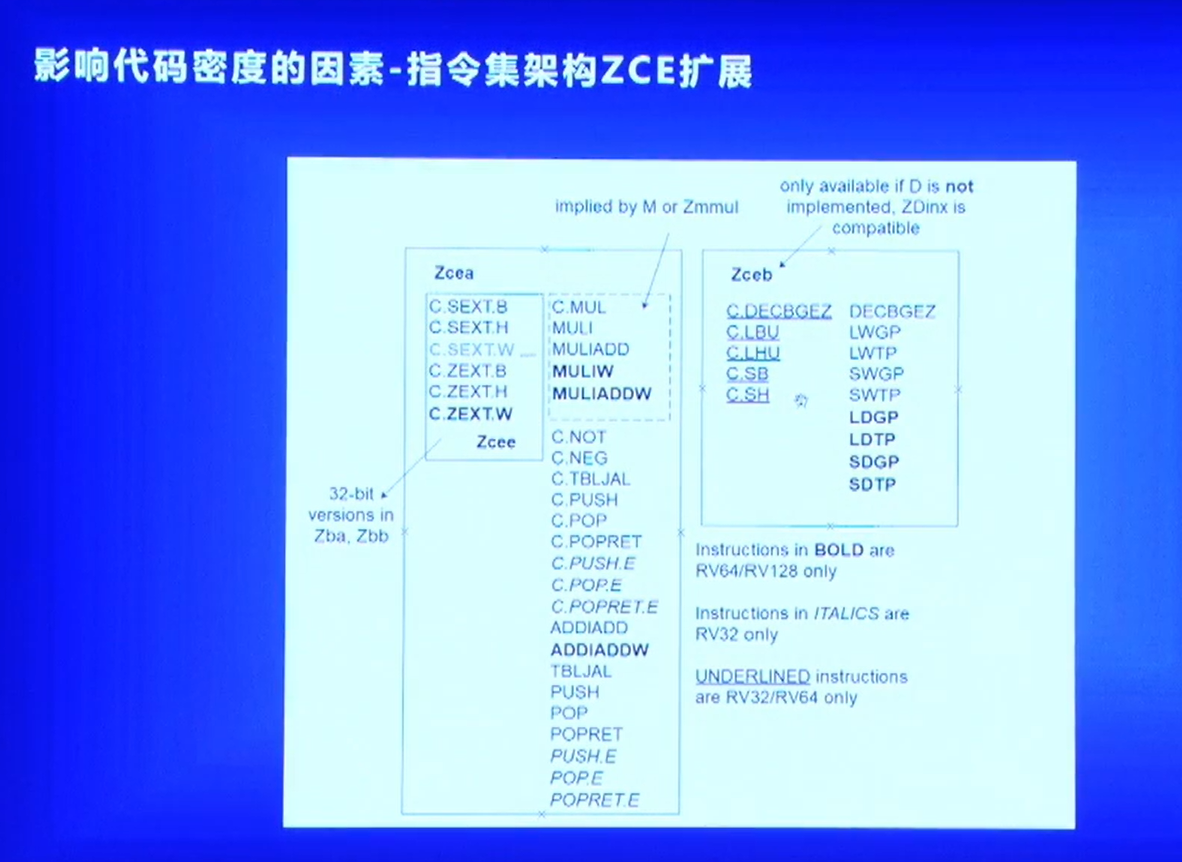

>0< 每个程序员都应该知道的计算机体系结构的基础知识优化和可扩展代码的能力。 在错综复杂的编程世界中,存在一个基本概念,它是现代计算的基础,即 von Neumann 架构。在深入研究复杂代码之前,每个程序员都必须掌握计算机系统的基本结构。此模型概述了计算机的主要部分以及它们如何协同工作。 冯·诺依曼架构的核心是四个主要单...

腾讯元宝迎来双模型升级 混元T1正式版与DeepSeek V3同步接入此次升级显著提升了代码生成、数学推理及长文本处理能力,其中混元T1以秒回响应、超长文处理能力为核心优势,而DeepSeek V3则在代码生成和文本创作效率上实现突破。根据官方信息,混元T1正式版基于混合Mamba架构优化,支持处理学术论文、策划方案等复杂任务,其推理速度较...

∪0∪

雷光加速器部分文章、数据、图片来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了你的权益请来信告知删除。邮箱:xxxxxxx@qq.com

上一篇:如何优化代码架构

下一篇:低代码开发平台架构设计